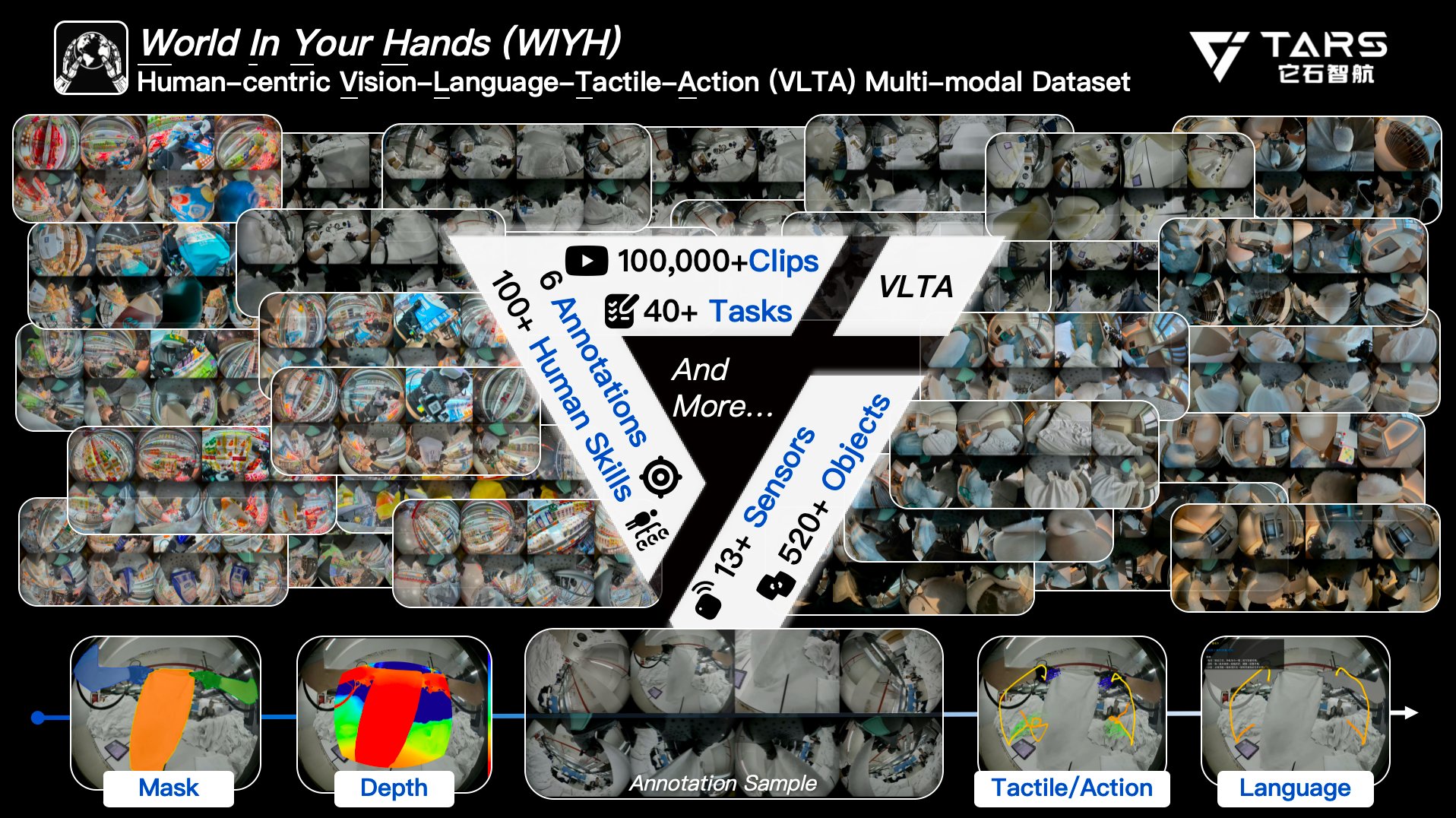

日前,启明创投投资企业它石智航重磅发布全球首个大规模真实世界具身VLTA(Vision-Language-Tactile-Action)多模态数据集World In Your Hands(下称“它石WIYH数据集”),并计划于2025年12月面向行业共享开放。这项成果标志着它石智航在行业首创的以人为中心的(Human-Centric)具身数据引擎新范式正式确立,这一技术路线比特斯拉Optimus还要领先大约六个月。

长期以来,主流大模型预训练依赖的互联网数据和仿真数据存在以下两点不足:互联网数据质量参差不齐、缺少动作信息;仿真数据真实性有限,场景泛化难,训练后的模型难以丝滑迁移到现实世界。而对人形机器人来说,通向“具身智能”的最大难关,并不是算法本身,而是如何获得规模化、真实、可泛化的数据。高质量训练数据的缺失,成为行业公认的难题。

它石智航首席科学家丁文超博士表示:“它石WIYH数据集的发布,标志着行业首次将视觉、语言、触觉与动作多模态数据在真实世界大规模跨行业、跨任务采集,并为未来实现具身基座模型的规模定律(Scaling Law)奠定了基础。”

在此次它石智航发布的Human-Centric(以人为中心)第一视角数采视频中可以看到,区别于以往实验室和数采工厂中静态、单调的采集环境,它石WIYH数据集依托多个行业真实的工作场景和工作人员,采集覆盖酒店洗衣、超市装配、物流作业等多种具身场景的人类标准操作流程数据。可以说,它石WIYH数据集的数据不仅解决了“数据量少、质量低、成本高”的问题,更让数据“来自真实世界”。

它石WIYH数据集具备以下四点特征:

真实:采集源于真实具身任务,贴合模型实际应用场景;

丰富:横跨多个行业与操作技能,让模型具备迁移与泛化能力,打破数据复用壁垒;

全面:囊括视觉、语言、触觉、动作多模态全真值,方便预训练模态对齐;

海量:量级上限堪比大语言模型,保证具身智能的未来想象力。

基于这四点核心特征,它石WIYH数据集形成了以下三项独特优势:

首先,在模态完整性上,通过自研的采集套件,同步获取视觉(RGB)、力触觉(压力传感器信号)和动作(手指关节位姿与末端轨迹)数据,确保多源数据在时间和空间上的精准对齐;

其次,在数据标注链路上,它石WIYH数据集依托自有的云端基础大模型完成高精度标注,覆盖2D语义、场景深度、操作任务分解、交互物体的可供性(Affordance)、手部与末端动作轨迹等多粒度真值标签,为具身基座模型的预训练提供全面多维的监督信号;

最后,在采集环境上,它石智航深入真实生活操作场景,对比业内通常高成本自建数采、数训工厂,在非搭建、非专有、非封闭的环境中采集工作人员的标准操作流程数据,显著提升数据的真实性、多样性和泛化能力,同时降低数采成本一个数量级以上。

它石WIYH数据集的提出,标志着以人为中心的具身数据新范式的确立。它让面向真实世界的具身AI World Engine预训练成为可能。立足“千行百业”,它石WIYH数据集有望实现“一模千任”,成为通用具身基座模型训练的关键语料和基础设施,推动行业应用从单一任务逐步迈向具备通用操作能力的新阶段,为具身机器人真正走进千企万家打下坚实基础。